Los modelos de lenguaje grandes (LLMs, por sus siglas en inglés) están demostrando su capacidad para atender una variedad de tareas en el ámbito del procesamiento del lenguaje natural, desde la conversación básica hasta la compleja toma de decisiones y la elaboración de resúmenes. Sin embargo, las complejidades en la alineación de estos modelos con las intenciones del usuario han resultado ser un desafío persistente. Las técnicas tradicionales, como la ingeniería de prompts y el ajuste fino supervisado, frecuentemente se quedan cortas en este aspecto, provocando en ocasiones la creación de respuestas que pueden contener información errónea, sesgos o incluso ser tóxicas.

El ajuste fino mediante aprendizaje supervisado puede mejorar estas herramientas, pero enfrenta dificultades a la hora de capturar las intricadas cuestiones éticas y sociales que escapan a ejemplos simples. Esto puede conducir a resultados inesperados que desvían al modelo de su objetivo inicial.

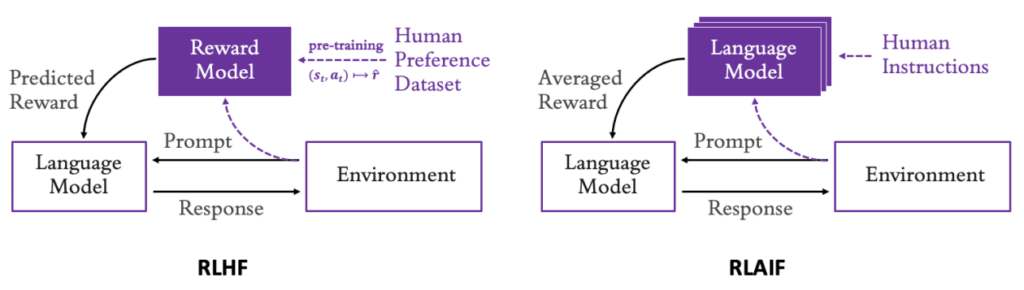

En respuesta a estos desafíos, ha surgido un enfoque novedoso conocido como entrenamiento por refuerzo con retroalimentación humana (RLHF). Este método implica entrenar modelos de recompensa basados en input humano para refinar el comportamiento de los LLMs según los valores y preferencias humanas. No obstante, investigaciones recientes indican que la retroalimentación de otros modelos de lenguaje también puede ser valiosa, llevando a lo que se llama superalineación utilizando retroalimentación de IA (RLAIF).

La técnica RLAIF permite el uso de múltiples LLMs, cada uno especializado en capturar un aspecto específico de las preferencias humanas, como la relevancia, brevedad o prevención de toxicidad. Esto elimina la necesidad de servicios humanos de anotación y mejora la eficiencia del proceso, logrando el desarrollo de sistemas que son útiles, veraces y no nocivos, incluso cuando algunas capacidades de IA igualen o superen el rendimiento humano.

Un ejemplo de aplicación de RLAIF podría ser en la reducción de la toxicidad en respuestas generadas a partir de un conjunto de diálogo. Utilizando modelos de recompensa disponibles al público, los LLMs pueden ser ajustados y luego evaluados con datos reservados para medir el éxito de estos ajustes.

En síntesis, el progreso y la calibración de los LLMs es un campo en constante evolución. Las técnicas como RLAIF prometen realinear la inteligencia artificial con las preferencias humanas, ofreciendo así respuestas más seguras y útiles. La investigación continua es crucial para abordar los retos éticos y técnicos que surgen con las tecnologías de inteligencia artificial actuales.