En un mundo donde la inteligencia artificial generativa está en pleno auge, las empresas buscan modelos que se adapten a sus necesidades específicas en áreas como la resumición de documentos y la generación de contenido. Para cumplir con estas demandas, las organizaciones están adoptando modelos de lenguaje grande (LLMs) específicos de dominio, diseñados para llevar a cabo tareas especializadas en sectores como las finanzas, ventas, marketing, TI, y salud. Esta personalización permite ofrecer experiencias adaptadas al cliente, mejorando la innovación y el servicio.

Sin embargo, la implementación de estos modelos en el ámbito empresarial no está exenta de desafíos. Los modelos estándar suelen no contar con el conocimiento necesario para ciertos dominios, lo que empuja a las empresas a desarrollar soluciones a medida. Esto genera la necesidad de gestionar múltiples modelos adaptados a distintos casos de uso, lo cual puede ser costoso y complejo. Las soluciones tradicionales para el hospedaje de estos modelos a menudo consumen demasiados recursos y generan cuellos de botella.

Aquí es donde entra en juego la técnica Low-Rank Adaptation (LoRA). Esta metodología permite adaptar eficientemente modelos de lenguaje preentrenados a nuevas tareas al introducir pequeñas matrices de pesos entrenables. En vez de fusionar estas capas con los pesos del modelo base, lo cual resulta poco eficiente, LoRA y su software de código abierto LoRAX ofrecen un enfoque más económico y eficaz para manejar la creciente cartera de modelos de las empresas.

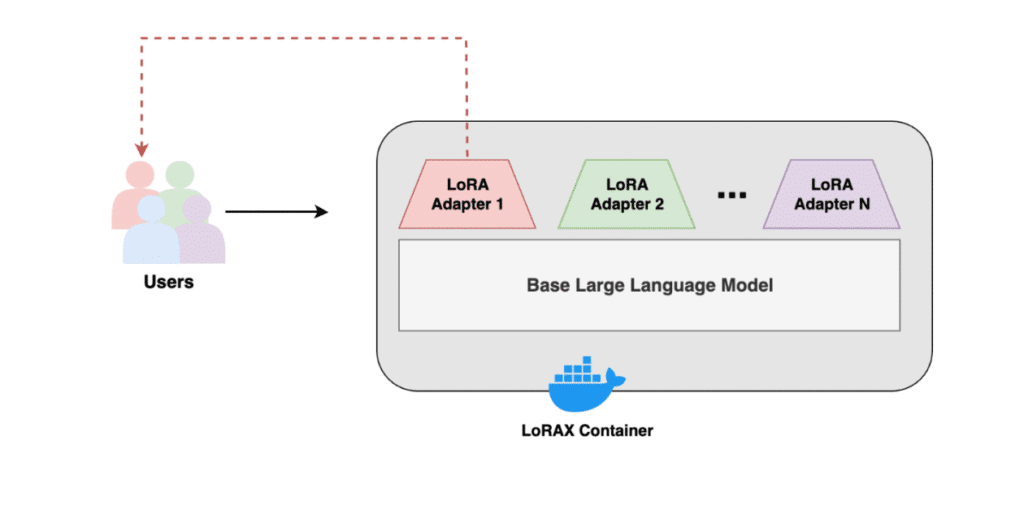

LoRAX facilita el intercambio de pesos para la inferencia, permitiendo que las organizaciones gestionen múltiples modelos afinados en una única instancia, como es el caso de EC2 en AWS. Esto no solo reduce significativamente los costos, sino que también evita comprometer el rendimiento del sistema. La adaptabilidad de LoRAX y su comunidad activa de apoyo en AWS destacan su potencial como una solución clave para el despliegue de modelos de IA generativa en entornos empresariales donde se requiere soporte robusto.

En resumen, LoRAX no solo optimiza la gestión de modelos a gran escala, sino que también proporciona una mayor flexibilidad y control en la evaluación de costos asociados. Así, las empresas pueden maximizar el uso de modelos de fundación adaptados a sus necesidades, afirmando su posición en la era digital.