PowerSchool, el destacado proveedor de software en la nube para la educación K-12, ha lanzado PowerBuddy™, un asistente de inteligencia artificial diseñado para brindar apoyo a más de 60 millones de estudiantes en más de 90 países. Este innovador asistente está integrado en diversas plataformas educativas, facilitando así la interacción entre estudiantes y sus redes de apoyo. Sin embargo, uno de los grandes desafíos al introducir PowerBuddy ha sido implementar un sistema de filtrado de contenido que garantice la seguridad de los estudiantes, especialmente en entornos educativos con numerosos usuarios menores de edad.

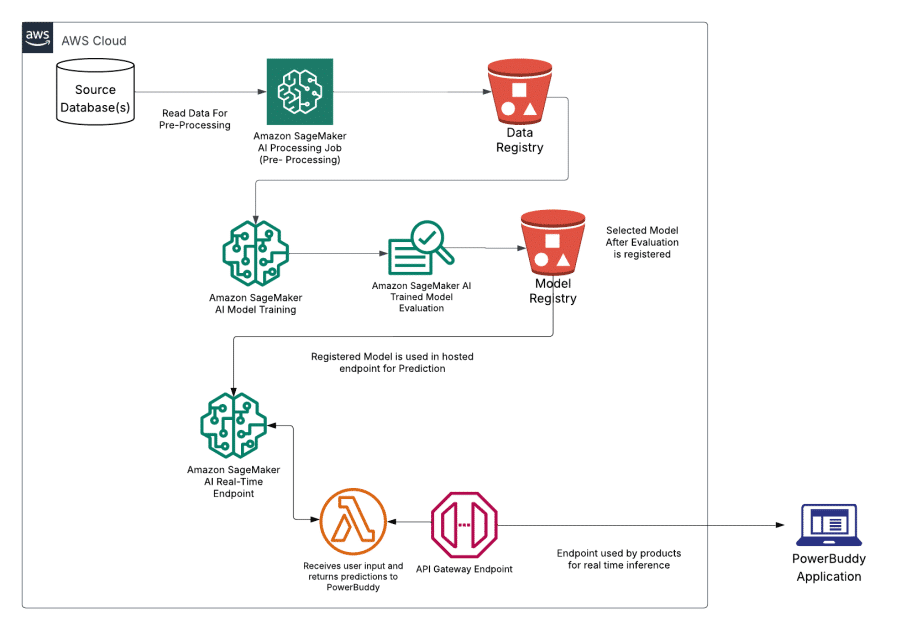

Para proteger a los estudiantes de contenidos perjudiciales, PowerSchool ha desarrollado una solución personalizada de filtrado de contenido a través de Amazon SageMaker AI. Este sistema no solo identifica y bloquea contenidos dañinos, como el acoso escolar o discursos de odio, sino que también evita interferir en discusiones académicas legítimas, un aspecto crítico al enseñar temas sensibles. Por ejemplo, es esencial que un examen histórico no sea erróneamente clasificado como contenido violento.

La solución incluye una serie de características avanzadas, desde la preparación de datos hasta la arquitectura de inferencia. Utilizando técnicas de adaptación de bajo rango (LoRA), el equipo ajustó el modelo Llama 3.1 8B para garantizar su precisión en este contexto específico. Las pruebas posteriores a la implementación demostraron un 93% de precisión en la identificación de contenidos dañinos y una tasa de falsos positivos inferior al 3.75%, lo que constituye una mejora notable respecto a soluciones genéricas.

La eficacia de este sistema personalizado ha incrementado la confianza en el uso de herramientas de inteligencia artificial en las aulas. La recolección continua de feedback y las pruebas A/B han permitido realizar ajustes en tiempo real para mantener y mejorar la eficacia del filtrado de contenido.

Con la integración de PowerBuddy en otros productos de PowerSchool, la compañía planea futuras adaptaciones del modelo de filtrado, buscando un equilibrio entre innovación educativa y seguridad estudiantil. La meta es construir un entorno de aprendizaje seguro donde los estudiantes puedan aprender sin riesgo de exposición a contenidos nocivos.